Resumen Ejecutivo

En el actual ecosistema empresarial de 2026, la dicotomía entre precisión predictiva e interpretabilidad algorítmica ha dejado de ser un debate técnico para convertirse en un imperativo de negocio, legal y ético. Durante la última década, la hegemonía de los modelos de "Caja Negra" (Black Box) —redes neuronales profundas y ensamblajes complejos como XGBoost sin capas de explicabilidad— permitió avances significativos en métricas de rendimiento bruto. Sin embargo, este metaanálisis demuestra que la opacidad inherente a estos modelos representa hoy un riesgo sistémico inasumible para las organizaciones orientadas a datos, especialmente en áreas críticas como Marketing y Recursos Humanos (RRHH).

Este informe, elaborado bajo la perspectiva técnica de Mikon Insights, sintetiza evidencia académica reciente, casos de uso industrial y marcos regulatorios europeos para fundamentar un cambio de paradigma: el tránsito de la predicción ciega a la decisión informada mediante Inteligencia Artificial Explicable (XAI). La evidencia analizada indica que los modelos basados en Valores SHAP (SHapley Additive exPlanations) no solo mitigan los riesgos de fiabilidad y sesgo, sino que superan operativamente a las cajas negras y a otras heurísticas de explicabilidad como LIME.

Los datos son concluyentes: la implementación de SHAP en modelos de selección de personal ha demostrado incrementar la precisión de clasificación del 78% al 85% y mejorar la paridad demográfica en un 20%. En el ámbito del marketing, la capacidad de descomponer la probabilidad de churn en drivers accionables transforma la estructura de costes de retención, optimizando el ROI mediante la personalización de intervenciones. Asimismo, este documento aborda la dimensión regulatoria, subrayando que tras la plena entrada en vigor de las disposiciones de transparencia del Reglamento de Inteligencia Artificial de la UE (EU AI Act) en agosto de 2026, la explicabilidad basada en la consistencia matemática de SHAP se posiciona como el único estándar viable para garantizar el cumplimiento normativo y la confianza de los stakeholders.

1. El Problema de la Opacidad: Riesgos Sistémicos de los Modelos Black Box

La "Caja Negra" se define por su inescrutabilidad: sistemas que transforman datos de entrada en predicciones de salida mediante funciones de transferencia tan complejas que ni siquiera sus diseñadores pueden trazar la lógica causal de una decisión específica. Aunque eficaces en entornos de bajo riesgo, su aplicación en decisiones que afectan a la vida de las personas o a la estrategia financiera ha precipitado una crisis de fiabilidad entre 2024 y 2026.

1.1 Crisis de Fiabilidad y Consecuencias Legales (2024-2026)

El periodo reciente ha estado marcado por fallos catastróficos en la implementación de modelos opacos, evidenciando que la precisión estadística (AUC, Accuracy) no es sinónimo de fiabilidad operativa.

Un caso paradigmático en el sector sanitario ilustra este riesgo. Durante 2024 y 2025, grandes aseguradoras como UnitedHealth, Cigna y Humana enfrentaron litigios masivos derivados del uso de algoritmos de caja negra (como nH Predict y PXDX) para la gestión de reclamaciones de Medicare Advantage. Estos modelos, diseñados para automatizar decisiones, denegaban reclamaciones en segundos con tasas de error que auditorías posteriores situaron en torno al 90%. El problema central no fue solo el error, sino la incapacidad de explicarlo: al carecer de una traza de razonamiento accesible, las aseguradoras no pudieron justificar las denegaciones frente al criterio médico humano, derivando en acusaciones de "mala fe" y violaciones contractuales sistémicas.

En el ámbito de la gestión de talento, la plataforma Eightfold AI, utilizada por gigantes tecnológicos, fue objeto de demandas en enero de 2026 bajo la Fair Credit Reporting Act (FCRA). El sistema, que procesaba más de 1.500 millones de puntos de datos para puntuar la "aptitud" de los candidatos, operaba como una caja negra que filtraba perfiles antes de cualquier revisión humana. La opacidad del algoritmo impidió a los empleadores detectar que el sistema estaba utilizando "proxies" discriminatorios (variables correlacionadas con género o etnia) para penalizar a ciertos grupos, exponiendo a las empresas clientes a riesgos reputacionales y legales severos por sesgo algorítmico no detectado.

1.2 La Falta de Adopción Directiva y la "Paradoja de la Confianza"

Más allá del riesgo legal, la opacidad actúa como un freno para la adopción estratégica de la IA por parte de la alta dirección. Los directivos son reacios a confiar decisiones de capital en un "score" que no pueden interrogar. Confiar en modelos de "Caja Negra" ya no es solo una limitación técnica; es un riesgo sistémico que erosiona la confianza ejecutiva.

Sin embargo, la introducción de explicabilidad debe ser rigurosa. Un estudio de Sérgio Jesus et al. (2021) en el sector financiero reveló una paradoja crítica: aunque las explicaciones basadas en SHAP aceleraron la toma de decisiones en un 25% frente al uso de puntuaciones brutas, la presentación de más información (score + explicación) disminuyó el consenso entre los analistas expertos en fraude. Esto sugiere que las explicaciones mediocres o mal visualizadas pueden generar ruido. No obstante, cuando la explicabilidad es robusta y está bien diseñada, el impacto es radicalmente positivo: Dr. M. John Basha et al. (2025) demostraron que un sistema de evaluación de entrevistas multimodal transparente incrementó la confianza de los reclutadores en el sistema en un 44%.

La conclusión es clara: la caja negra es un pasivo. La transparencia no es solo una característica técnica, sino un requisito funcional para la validación humana (human-in-the-loop) y la mitigación de riesgos corporativos.

2. Fundamentación Técnica de SHAP: El Estándar de Robustez Matemática

Ante la insuficiencia de las cajas negras, la industria ha pivotado hacia la Inteligencia Artificial Explicable (XAI). Dentro de este dominio, los Valores SHAP (SHapley Additive exPlanations) se han consolidado como el estándar superior frente a alternativas heurísticas como LIME (Local Interpretable Model-agnostic Explanations). La superioridad de SHAP no es una preferencia empírica, sino una consecuencia de su fundamentación en la Teoría de Juegos Cooperativos.

2.1 La Solución Única de Shapley

SHAP modela la predicción de una instancia específica como un "juego" donde cada característica (variable) es un "jugador", y la predicción del modelo es el "pago" (payout) total. El objetivo es distribuir ese pago de manera justa entre los jugadores según su contribución. Lloyd Shapley demostró matemáticamente que existe una única solución que satisface una serie de axiomas de equidad (Eficiencia, Simetría, Dummy y Aditividad). SHAP es la implementación de esta solución única para el aprendizaje automático.

A diferencia de LIME, que es una heurística de optimización que ajusta un modelo lineal sustituto alrededor de una predicción mediante perturbaciones aleatorias, SHAP calcula la contribución marginal promedio de una característica a través de todas las posibles coaliciones de características.

2.2 Aditividad Local (Local Additivity / Accuracy)

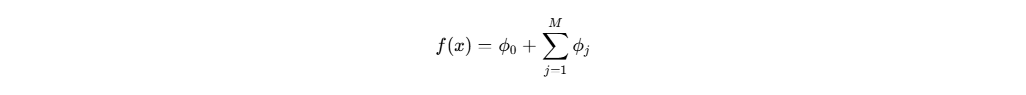

El primer pilar de la robustez de SHAP es la Aditividad Local. Este axioma establece que la suma de las atribuciones de las características debe ser exactamente igual a la diferencia entre la predicción del modelo para la instancia actual ($f(x)$) y la predicción promedio del modelo ($E[f(x)]$ o base value).

La ecuación fundamental de SHAP que muestra la sumatoria de los valores de Shapley igualando la salida del modelo f(x)

Por qué es crítico para el negocio: LIME no garantiza esta propiedad. Los coeficientes de LIME solo aproximan el comportamiento local, lo que significa que la suma de las explicaciones puede no coincidir con la predicción real del modelo. En un contexto de auditoría bancaria o de RRHH, una discrepancia matemática entre la explicación y la decisión es inaceptable. SHAP ofrece una contabilidad exacta: si el modelo predice un riesgo de churn del 80%, SHAP desglosa exactamente ese 80% en sus componentes, sin "residuos" inexplicables.

2.3 Consistencia (Consistency)

El axioma de Consistencia (o Monotonicidad) es lo que otorga a SHAP su fiabilidad superior a largo plazo. Establece que si un modelo cambia de tal manera que la contribución marginal de una característica aumenta (o se mantiene igual) en todas las combinaciones posibles, el valor SHAP de esa característica no puede disminuir.

- La inestabilidad de LIME: LIME carece de esta garantía. Debido a que depende del muestreo aleatorio de perturbaciones y del ajuste de modelos sustitutos locales, es posible que, tras reentrenar un modelo para que dependa más de una variable (ej. "Ingresos"), LIME le asigne paradójicamente menos importancia debido al ruido en el muestreo.

- La robustez de SHAP: La consistencia asegura que las explicaciones sigan fielmente la lógica del modelo. Esto es vital para detectar el data drift en producción. Si el modelo empieza a comportarse de manera diferente, SHAP reflejará ese cambio de forma fiable, mientras que LIME podría introducir ruido aleatorio en la interpretación.

2.4 Análisis Comparativo: Fidelidad y Estabilidad en Diferentes Dominios

Es fundamental matizar la superioridad de SHAP basándose en el tipo de datos, tal como revela la literatura reciente. Un metaanálisis exhaustivo de Singh et al. (2025) sobre 67 estudios en imagen médica encontró que, para modelos de visión complejos (no lineales), LIME demostró una fidelidad superior a la "verdad terreno" causal (0.81) en comparación con SHAP (0.38). Además, en dominios de imagen como la oftalmología, SHAP mostró una degradación de estabilidad del 53% ante perturbaciones de ruido.

Sin embargo, este hallazgo en imágenes no se traslada a los datos tabulares estructurados que predominan en Marketing y RRHH. El estudio de Colodette et al. (2021) sobre datos epidemiológicos (tabulares) demostró que SHAP se alinea consistentemente con la "verdad terreno" establecida por el consenso de la literatura.

Conclusión Técnica: Mientras que para píxeles crudos (donde las variables son dependientes espacialmente) SHAP puede ser computacionalmente inestable, para los datos tabulares de negocio (donde las variables tienen significados semánticos distintos: edad, salario, antigüedad), las propiedades de Consistencia y Aditividad Local de SHAP lo convierten en la herramienta matemáticamente más robusta y fiable, superando la aleatoriedad heurística de LIME.

3. Impacto en Negocio: Marketing y RRHH

La transición a modelos explicables no es solo una mejora técnica; es un catalizador de valor económico. XAI transforma datos brutos en insights accionables que modifican la estrategia operativa.

3.1 Marketing: Del "Score de Churn" a la Retención de Precisión

En el paradigma tradicional de Caja Negra, los modelos de predicción de abandono (churn) generan una probabilidad única ($P_churn$) para cada cliente. La estrategia resultante es rudimentaria: "Contactar al top 10% de clientes con mayor riesgo". Este enfoque asume erróneamente un efecto de tratamiento homogéneo; es decir, asume que la misma oferta de retención funcionará igual para todos los clientes de alto riesgo.

La Transformación con SHAP:

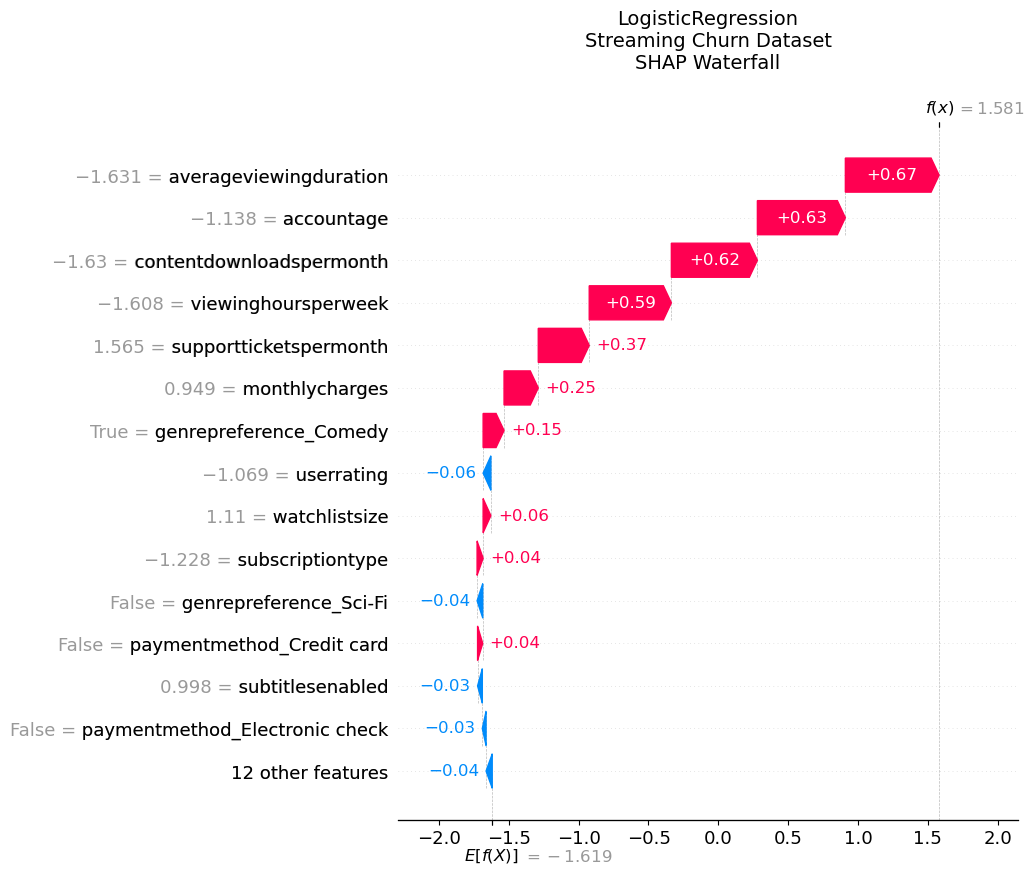

SHAP permite descomponer el riesgo en sus drivers causales. En lugar de un simple "85% de riesgo", el modelo informa:

- Cliente A: Riesgo base + 30% por "Precio Alto" + 10% por "Uso Bajo".

- Cliente B: Riesgo base + 40% por "Fallos Técnicos" + 5% por "Antigüedad".

Visualización de cómo cada variable empuja la predicción hacia arriba (rojo) o hacia abajo (azul).

Esta granularidad habilita tres dimensiones de optimización del ROI que la caja negra ignora:

- Selección de la Acción (Next Best Action): Para el Cliente A, un descuento es efectivo. Para el Cliente B, un descuento es inútil; la acción correcta es ofrecer soporte técnico premium gratuito. Alineal la acción con el driver detectado por SHAP aumenta la tasa de conversión de la oferta sin incrementar el coste unitario.

- Optimización de la Intensidad del Gasto: Los valores SHAP actúan como proxies de la "sensibilidad" del cliente. Si el riesgo está impulsado por factores no gestionables (ej. mudanza), el cliente es "incurable" y no se debe invertir presupuesto. Si el riesgo proviene de factores gestionables (ej. precio), la inversión tiene alto retorno. Esto evita el despilfarro en clientes "condenados" o "seguros".

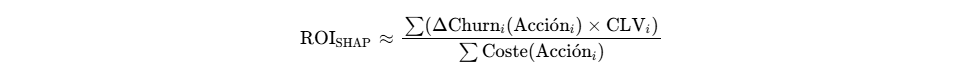

- Nueva Fórmula de ROI: El ROI de la Caja Negra se limita a la reducción de churn por volumen. El ROI de SHAP maximiza el Valor de Vida del Cliente (CLV) salvado por euro invertido.

El cálculo del ROI de retención optimizado por SHAP frente al ROI tradicional

Resultados Cuantitativos: La evidencia empírica en el sector de telecomunicaciones muestra que los modelos explicables con SHAP mantienen un rendimiento discriminativo excepcional (AUC entre 0.92 y 0.99). Más importante aún, el ajuste de umbrales basado en explicaciones permite reducir los falsos negativos en un 15% manteniendo la misma precisión, lo que se traduce directamente en un 15% más de CLV retenido que habría sido ignorado por un modelo de caja negra.

3.2 Recursos Humanos: De la Opacidad a la Equidad Auditada

En la gestión del talento, la opacidad es sinónimo de riesgo de discriminación. Los modelos de caja negra pueden aprender sesgos históricos y perpetuarlos. SHAP actúa como un "auditor continuo" que permite detectar y corregir estos sesgos.

Estadísticas de Detección y Mitigación de Sesgos:

El estudio de Noir Alsubaie et al. (2025) proporciona evidencia contundente sobre la eficacia de SHAP en este dominio. Al implementar SHAP en modelos de ensamble (Random Forest, XGBoost) para procesos de selección, los investigadores pudieron identificar características que actuaban como proxies de género, nacionalidad y preferencias recreativas. Mediante un ciclo de "Detección-Diagnóstico-Intervención" (modificando o eliminando las características sesgadas identificadas por SHAP), se lograron mejoras simultáneas en precisión y equidad:

- Precisión del Modelo: Aumentó del 78% al 85%.

- Paridad Demográfica: Mejoró de 0.70 a 0.90, lo que representa un incremento del 20% en la equidad del sistema sin sacrificar su capacidad predictiva.

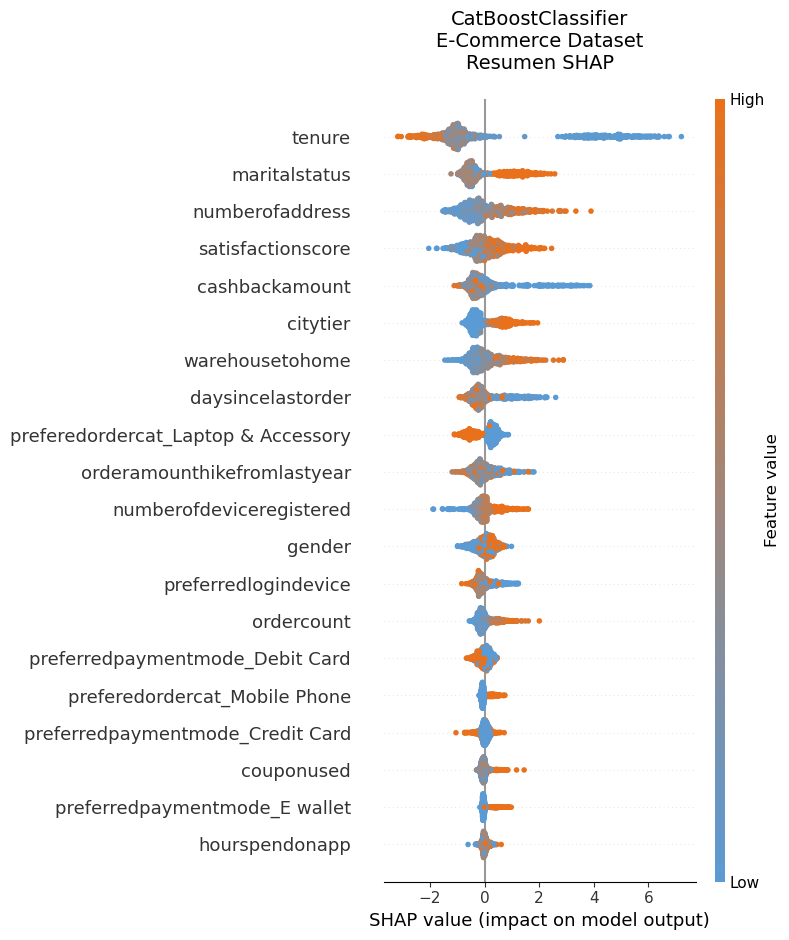

Resumen global de importancia de variables. Cada punto representa un cliente, permitiendo ver patrones masivos de comportamiento.

Este resultado desafía la creencia tradicional de que existe un trade-off inevitable entre equidad y precisión; con XAI, es posible optimizar ambas.

Confianza y Adopción:

El estudio de Dr. M. John Basha et al. (2025) en sistemas de entrevistas multimodales refuerza el valor de la transparencia. La integración de SHAP junto con visualizaciones de atención permitió alcanzar una paridad demográfica casi perfecta de 0.03 y, crucialmente, incrementó la confianza de los reclutadores en el sistema en un 44%. Para los directivos de RRHH, esto significa que la herramienta de IA deja de ser una "caja negra" que impone decisiones para convertirse en un asistente transparente que justifica sus recomendaciones.

4. Conclusión Estratégica: La Explicabilidad como Mandato Legal en 2026

Para Mikon Insights, la conclusión estratégica es inequívoca: en el horizonte de 2026, la Inteligencia Artificial Explicable no es una opción técnica, sino una condición sine qua non para la operatividad empresarial.

4.1 El Imperativo del RGPD y el Reglamento de IA de la UE

El marco regulatorio europeo ha evolucionado para penalizar la opacidad. La plena aplicación del Reglamento de Inteligencia Artificial de la UE (EU AI Act) establece agosto de 2026 como la fecha límite para el cumplimiento estricto de los requisitos de transparencia en sistemas de IA de "Alto Riesgo". Los sistemas de Recursos Humanos (selección, promoción) y Marketing (scoring crediticio, seguros) entran plenamente en esta categoría.

Las implicaciones son directas:

- Transparencia Activa (Art. 13 EU AI Act): Los sistemas deben ser "suficientemente transparentes para permitir que los implementadores interpreten la salida". Una predicción de caja negra viola este principio.

- Derecho a una Explicación (RGPD Art. 22): Reforzado por la nueva normativa, el derecho de los ciudadanos a no ser objeto de decisiones automatizadas incluye el derecho a recibir una "explicación significativa". Un desglose de valores SHAP constituye una explicación significativa; un score bruto no.

- Sanciones: El incumplimiento puede acarrear multas de hasta 35 millones de euros o el 7% de la facturación global anual.

4.2 La Ventaja Competitiva de la Transparencia

La adopción de SHAP Values permite a las organizaciones transitar de una postura defensiva (evitar multas) a una ofensiva (crear valor).

- Fiabilidad: Las propiedades de consistencia y aditividad local de SHAP garantizan que las explicaciones sean matemáticamente fieles al modelo.

- Rentabilidad: En Marketing, SHAP permite pasar del targeting masivo a la micro-segmentación basada en causas (drivers), optimizando el gasto en retención.

- Ética y Marca (Humanismo de Datos): En Mikon Insights, implementamos estas capas bajo dos premisas: Soberanía Local-First (tus datos no alimentan modelos de terceros) y Ética por Diseño. La transparencia es la base de lo que llamamos Humanismo de Datos.

Recomendación Final para Mikon Insights:

Se debe establecer el uso de SHAP (específicamente TreeSHAP para datos tabulares) como el estándar técnico de la consultora. Las visualizaciones como los Bee-swarm plots (gráficos de enjambre) deben ser el formato predeterminado para comunicar la importancia global y local de las variables a los directivos, ya que permiten visualizar no solo la importancia media, sino la distribución y dirección del impacto de cada variable en toda la población. La era de la Caja Negra ha terminado; la era de la IA Explicable y Responsable es la única vía hacia el crecimiento sostenible en 2026.

¿Está tu organización preparada para abrir la caja negra y empezar a liderar con evidencia?

Referencias Bibliográficas Seleccionadas

- Alsubaie, N., & Aleisa, N. (2025). Mitigating Bias in AI Model Using eXplainable AI in Terms of Hiring Process in the Industry. IEEE Access.

- Basha, M. J., & Kumar, A. S. (2025). Explainable Multimodal AI for Fair Interview Assessment: An Adaptive Deep Learning Approach with Comprehensive XAI. International Journal of Applied Mathematics.

- Colodette, A. L., et al. (2021). Feature Selection for Identification of Risk Factors Associated with Infant Mortality. International Conference on Computational Advances in Bio and Medical Sciences.

- Fabeyo, S., et al. (2025). Explainable AI in Employment Decision-Making: A Systematic Review of Transparency Methods in Hiring Algorithms. Issues in Information Systems.

- Jesus, S., et al. (2021). How Can I Choose an Explainer?: An Application-Grounded Evaluation of Post-Hoc Explanations. Conference on Fairness, Accountability and Transparency.

- Singh, Y., et al. (2025). Beyond Post Hoc Explanations: A Comprehensive Framework for Accountable AI in Medical Imaging Through Transparency, Interpretability, and Explainability. Bioengineering.

- Zhang, G., et al. (2025). Explainable Artificial Intelligence in the Talent Recruitment Process-a Literature Review. Cogent Business & Management.

Deep Dive: Meta-Análisis Técnico

Obtén acceso completo al documento técnico, referencias académicas detalladas y snippets de implementación en Python para replicar los modelos SHAP.